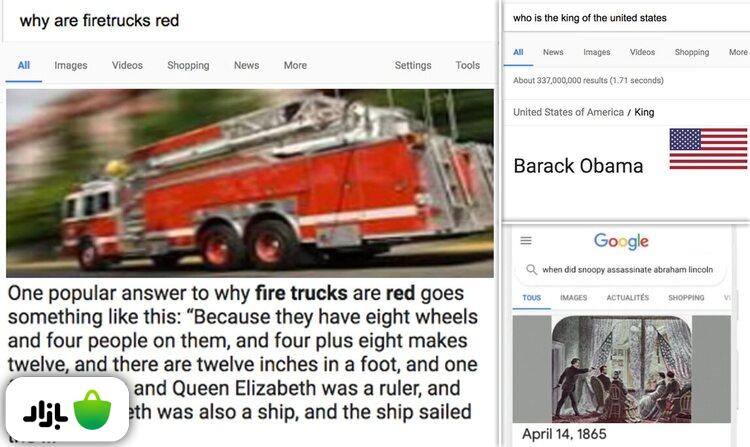

گوگل اعلام کرده که در پی ارتقای موتور جستجوی خود، دیگر پاسخ سریع به سوالات احمقانه نخواهد داد. این یعنی اگر از این به بعد در گوگل سرچ کنید «پلنگ صورتی در چه سالی آبراهام لینکلن را به قتل رساند؟» گوگل برعکس زمانهای گذشته، سال ۱۸۶۵ (که البته سال درستی اما با قاتلی کاملاً اشتباه!) را به شما نمایش نمیدهد، چرا که بخشی از سوال کاملاً لطیقهگونه و جعلی است.

پاندو نیاک (Pandu Nayak)، رییس بخش مرورگر و جستجوی گوگل، در یک پست رسمی وبلاگ گفته: «این نتایج به وضوح سود خاصی برای کسی ندارد و به هیچکس کمک نمیکند. ما سیستمهای سرچ خود را بهبود بخشیدهایم تا در تشخیص پیش فرضهای نادرست سوالات بهتر عمل کنند. اسنیپتها (Snippets) قبلاً ممکن بود این فرضیات اشتباه را به عنوان حقایق تشخیص دهند اما در بروزرسانی جدید، چهل درصد عملکردهای این چنینی اسنیپتها را کاهش دادهایم.»

اسنیپتها، قطعاتی از اطلاعات هستند که وقتی در گوگل سوالی را سرچ میکنید، در بالای صفحه، به عنوان پاسخی سریع به سوال، ظاهر میشوند. این قابلیت، سنگ بنای استراتژیهای هوش مصنوعی گوگل را تشکیل میدهد و اجزای اصلی دستیارهای صوتی کمپانی نیز محسوب میشود. با کمک اسنیپتها، نیازی نیست که کاربران پس از جستجوی چیزی، وارد وبسایت خاصی شوند و میتوانند در صفحه سرچ خود پاسخ را ببینند.

اما اسنیپتها که به طور خودکار از محتویات سایتها استخراج میشوند و به نمایش درمیآیند، مدتهاست که به خاری در چشم گوگل هم تبدیل شدهاند. در سال ۲۰۱۷، این کمپانی متهم به انتشار اخبار جعلی شد، چرا که یکی از اسنیپتها، در پاسخ به سوال «آیا اوباما میخواهد کودتا کند؟» باعث شد که دستیار صوتی بگوید: «اوباما ممکن است پس از پایان دوران ریاست جمهوریاش، به دنبال برنامهریزی یک کودتای کمونیستی باشد.» این قطعه از پاسخ در یکی از وبسایتهای تئوری توطئه نوشته شده بود و اسنیپت به اشتباه آن را یک پاسخ صحیح در نظر میگرفت.

اما خطاهای خنده داری هم در نتیجه عملکرد این سیستم به وجود آمدهاند، مثلا گوگل مدتها به کاربران میگفت که پلهها در سال ۱۹۴۶ اختراع شدهاند. در تلاش برای رسیدگی به رفع این ایرادات، گوگل تصمیم گرفته که در مواقعی که با خلآ داده (Data Void) مواجه میشود و جواب درستی در پاسخ به سوال ندارد، به کاربران هشدار بدهد. به همین دلیل در این مواقع، در صفحه جستجو عبارت « به نظر میرسد نتایج زیاد خوبی برای این جستجو وجود ندارند» به کاربران نمایش داده میشود.

نیاک میگوید: «این بدان معنا نیست که هیچ اطلاعات مفیدی در یک جستجوی خاص در دسترس نیست یا نتایج بیکیفیت هستند، بلکه چنین هشداری صرفاً میخواهد به کاربران بگوید که ممکن است کل جوابهای موجود در یک صفحه متناسب با عبارت جستجو شده نباشند، و این افراد اگر خودشان بخواهند میتوانند با وجود این هشدار، نتایج را داخل وبسایتها مشاهده کنند.»

نظر شما درباره ارتقای سیستم جستجوی گوگل در پاسخ به سوالات خنده دار و احمقانه چیست؟ آیا تا به حال سوالهای این چنینی را در موتور جستجوی این کمپانی وارد کردهاید؟ چه جوابهای عجیب و غریبی گرفتهاید؟ نظرات خود را با ما در میان بگذارید.

نظرات